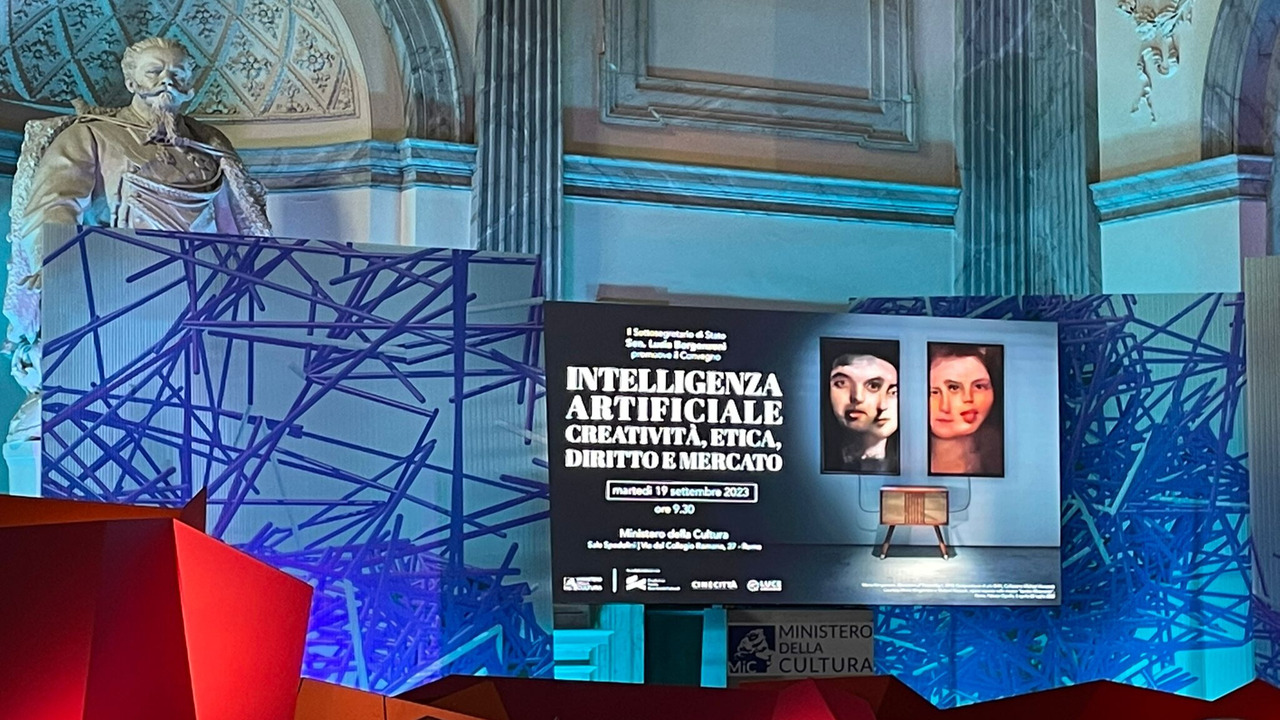

Le porte del Ministero della Cultura si aprono – fisicamente e metaforicamente – al futuro, in occasione del convegno “Intelligenza Artificiale: creatività, etica, diritto e mercato”, promosso dal Sottosegretario di Stato Lucia Borgonzoni e tenutosi ieri presso la Sala Spadolini del MiC. Un appuntamento la cui linea guida di pensiero e di azione è stata, come affermato dalla stessa Borgonzoni, “la centralità dell’uomo sulla macchina, a tutela della creatività umana e della proprietà intellettuale nonché delle opere stesse”. Nomi di spicco per una giornata densa di contenuti e spunti di riflessione: dal diritto d’autore all’apporto culturale dell’IA nel mercato del lavoro, dalle implicazioni etiche ai rischi per la creatività.

Il Sottosegretario Borgonzoni dà il via ai lavori introducendo il primo panel: “Spesso si parla di IA dal punto di vista tecnico, ma dovremmo cominciare ad interrogarci anche su temi connessi, come quello dei brevetti e della necessità di difendere il diritto d’autore”. Il mondo dell’audiovisivo, in questo senso, è chiamato a porsi domande precise e razionali e a esplorare i dilemmi etici, mantenendo un approccio laico che consenta di guardare le cose con obiettività. Dove finisce l’etica e dove comincia l’aspetto legale? Gli esperti analizzano le attuali norme europee e internazionali riguardanti il diritto d’autore. La professoressa Ordinaria di Diritto dell’Economia all’UER, Valeria Falce afferma: “Dal 2019 esiste una direttiva europea che spinge ad adeguare il diritto d’autore alle nuove tecnologie. È una ricompensa fondamentale per lo sforzo creativo dell’uomo e va tutelata e precisata ora ancora di più”. Di parere opposto è l’intervento provocatorio di Massimiliano Fuksas, che sottolinea come “bisogna abolire il diritto d’autore. Il concetto di copia viene dalla religione cattolica, la nostra cultura è ossessionata da chi ci copia, ma in realtà tutti copiano tutti”.

Ma la preoccupazione sull’utilizzo da parte dell’IA di opere protette da copyright non è esclusivamente di natura economica. Nicola Borrelli, Direttore della Direzione generale Cinema e audiovisivo e Paolo del Brocco, Amministratore delegato di Rai Cinema, affrontano il problema del “materiale di addestramento”, prevedendo sì un equo compenso per l’utilizzo delle opere protette, ma ricordando che il diritto d’autore prevede anche delle tutele morali, che si dovranno rispettare. Come si dovrà tenere conto anche della privacy e della sicurezza dei dati utilizzati dall’IA.

Dalla questione sulla proprietà intellettuale si passa all’impatto sulle comunicazioni e sull’informazione. Nel secondo panel si è discusso su come l’IA rappresenti una soluzione di continuità sia per quanto riguarda la produzione sia la diffusione delle informazioni. Del resto, non esiste un algoritmo che analizzi l’attendibilità delle notizie e l’IA potrebbe diventare un portale verso mondi paralleli, sempre più personalizzati e non comunicanti tra di loro. Ogni utente viene soddisfatto dalla sua bolla di informazioni fatta su misura per lui in cui la disinformazione regna sovrana, soprattutto se si pensa al cosiddetto problema della “trasparenza e spiegabilità”. In molti casi, i modelli di IA sono così complessi che è difficile spiegare come giungano a determinate conclusioni. Questa mancanza di trasparenza può essere problematica, soprattutto se il mondo che verrà appalterà il controllo sulla veridicità dell’informazione a un software che non può rendere conto delle sue fonti.

Il terzo panel si è occupato degli effetti dell’IA sull’occupazione e sul mercato del lavoro. L’impatto sociale ed economico che l’IA potrebbe determinare rischia di creare o esacerbare divisioni all’interno del nostro tessuto sociale le cui ramificazioni non ci sono ancora chiare. Uno su tutti è la dipendenza tecnologica. La crescente dipendenza da sistemi basati su IA può portare a una perdita di abilità umane e a una maggiore vulnerabilità in caso di fallimenti tecnologici. L’appello alle istituzioni è incentrato sulla formazione: spesso i lavoratori meno qualificati sono quelli più a rischio di automatizzazione ed è per questo necessario che vengano messe in atto politiche volte alla tutela e allo sviluppo. Non luddismo, insomma, ma un progresso responsabile che non lasci indietro le fasce più vulnerabili della popolazione e della forza lavoro.

Dimostrazioni di buoni utilizzi di queste tecnologie sono state offerte durante il quarto panel, incentrato sulle applicazioni dell’IA nell’arte e nella cultura. Sono state, inoltre, presentate testimonianze delle potenzialità attuali e future dei vari software in diversi ambiti culturali, dall’architettura alla pittura, dalla moda all’audiovisivo, dalla musica ai videogiochi e all’editoria.

L’IA può essere utilizzata come strumento per assistere gli artisti nell’ispirazione, nella generazione di nuove idee o nello sviluppo di concetti innovativi; tecniche come il deep learning e la generazione di linguaggio naturale possono aprire la strada a nuove forme di espressione artistica. Queste tecnologie possono essere utilizzate per creare esperienze culturali immersive e personalizzate, che tengano conto non soltanto del grande pubblico, ma anche di parti della popolazione che fino ad ora non sono state rappresentate nei media su larga scala. Tutto questo abbattendo i costi di produzione, che fino ad ora sono stati un grande ostacolo per la realizzazione di opere cosiddette “di nicchia” o sperimentali.

Ha concluso la giornata il panel “Etica e Filosofia della Tecnologia”. Molti sono gli argomenti scottanti che si potrebbero citare: dalla criminalità tecnologica e l’hacking etico alla sorveglianza di massa al potenziale per l’arma autonoma, ma, per rimanere nel campo dell’audiovisivo, Luciano Floridi, Founding Director of the Digital Ethics Center and Professor in the Practice Yale University, sostiene che il nodo da sciogliere si trova nel modello della commercializzazione che, con l’avvento dell’IA ha visto ribaltare i ruoli di potere tra consumatore e produttore. “Non si tratta più di un processo broadcaster-spettatore, ma io spettatore che chiedo al Netflix di domani di fare un film solo per me”. Chi stabilisce quali contenuti sia appropriato produrre e distribuire? Insomma, la questione è una di controllo e responsabilità: non possiamo delegare la nostra responsabilità morale ad un meccanismo basato su decisioni autonome prese da un software. Il professore cita l’esempio di un doppiatore la cui voce può essere replicata all’infinito dall’IA. Tornano alla mente le dichiarazioni di Keira Knightley, preoccupata per la creazione di scansioni digitali degli attori e sul potere che l’IA ha di trattarli come burattini immortali all’interno delle produzioni audiovisive del futuro.

Gianluca Mauro, amministratore delegato AI Academy critica l’approccio fino ad ora seguito dalla Silicon Valley, rappresentato dall’aforisma di Mark Zuckerberg “muoviti velocemente e rompi le cose”. Questa de-responsabilizzazione diventa potenzialmente catastrofica se adoperata nell’utilizzo di uno strumento potente come l’intelligenza artificiale. Soprattutto se rischiosissimi difetti nascosti all’interno del codice più profondo del software producono effetti discriminatori. Gli algoritmi di IA possono essere influenzati dai dati con cui vengono addestrati, portando a discriminazioni etniche, di genere o di classe sociale nei risultati. Mauro cita come esempio il fatto che le foto che ritraggono le donne hanno molte più probabilità di essere categorizzate come “contenuti sessualmente suggestivi” dai social media. Così conclude: “Bisogna ricordarsi che questa è una tecnologia giovane, non è ancora ben compresa e dobbiamo essere molto attenti quando la distribuiamo. […] L’IA è nata l’altro ieri, è normale che ci siano dei problemi, ma questi problemi vanno risolti. Non possiamo aspettarci che si risolvano da soli. Il mio messaggio finale è che dobbiamo muoverci più responsabilmente e non lasciare nessuno indietro”.

Il convegno ha fornito una panoramica approfondita delle questioni legate all’IA nell’ambito culturale e artistico, con un focus particolare sul ruolo centrale del diritto d’autore e della regolamentazione. Gli esperti hanno sottolineato la necessità di equilibrare l’innovazione tecnologica con la protezione della creatività umana, garantendo che l’IA sia una forza da regolamentare e non una minaccia da cui proteggersi.

Nel suo intervento, il vicepremier Matteo Salvini traccia il sentimento che ha mosso le istituzioni a indire questo evento: “Vi prego di accettare la sfida ma, allo stesso tempo, di usare tutte le cautele possibili e immaginabili. Perché il bello dell’imperfezione, della sfumatura, del cambio di tono, di colore e l’emozione che ci mette l’operatore del cinema nel suo lavoro nessuna macchina mai potrà sostituirlo”.

Leggi qui la prima parte del nostro focus sull’IA.

Leggi qui la seconda parte del nostro focus sull’IA.

Leggi qui la terza parte del nostro focus sull’IA.